Apple propose une fonctionnalité de macOS 26 et iOS 26 Visual Intelligence™ via un simple navigateur en local

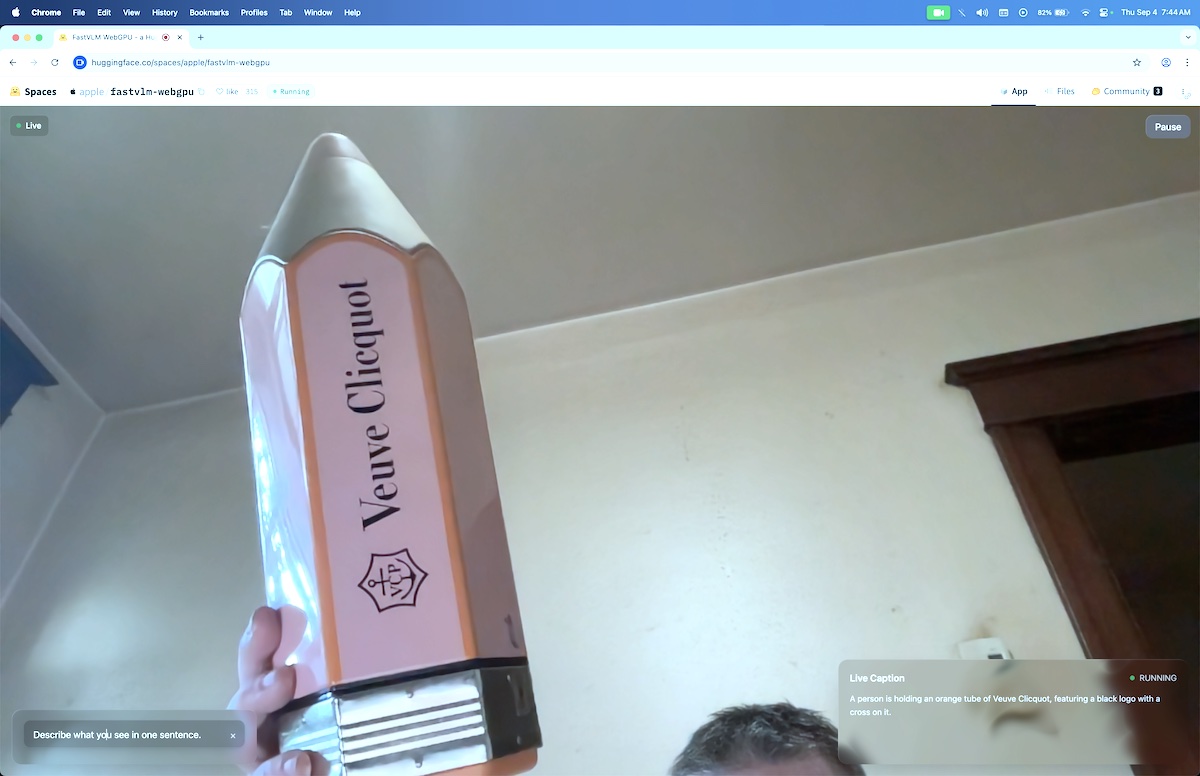

"Une personne tenant un tube/crayon orange de Veuve Cliquot"

macOS 26 et iOS 26 bêta ont amené une fonctionnalité permettant de prendre une photo et de la faire analyser par ChatGPT d'OpenAI après lui avoir transmise et sans informer l'utilisateur au préalable de cette transmission, ni sans avoir requis son accord.

Les points essentiels: limité aux Mac ARM et aux iPhone 16 et suivants, transmission à OpenAI pour ChatGPT, exécution dans le cloud et non locale. Pas de protection de la vie privée. Et juste une photo.

L'App mobile ChatGPT fait bien mieux sur tous les iPhone même anciens et sur tous les smartphone Android!

À quelques jours d'intervalle, Apple vient de présenter un modèle VLM (Visual Language Model ou Modèle de Langage Visuel), en plusieurs tailles, permettant d'identifier (et plus) ce qu'il y a dans un flux vidéo, en temps réel, tournant dans le navigateur (sauf Safari, c'est un gag!).

Essayez-le ici, c'est un peu lent. C'est sur GitHub et dans HuggingFace.

Les points essentiels: n'importe quel matériel PC ou smartphone Android inclus et bien sûr les anciens iPhone, aucune transmission d'image ou de vidéo dans le cloud. Protection de la vie privée. Et ça marche en temps-réel (ça lagge suivant le matériel) en n'étant pas restreint à une photo.

Je pense qu'on est là dans l'absurde le plus total, Apple est schizophrène, proposant d'excellentes technologies en accès libre et protégeant les données personnelles, tout en intégrant dans macOS et iOS les technologies d'autres acteurs (Google ou OpenAI) qui s'emparent de nos données personnelles en forçant leur envoi dans le cloud!

Que se passe-t-il chez Apple?!?